Analyse de la désinformation en Côte d’Ivoire lors de la présidentielle d’octobre 2025

Résumé exécutif

Ce rapport de situation (SITREP) analyse et synthétise les cas de désinformation observés en Côte d’Ivoire durant la présidentielle d’octobre 2025. Il évalue de manière exhaustive les éléments clés de la manipulation de l’information : les acteurs impliqués, les buts poursuivis, les campagnes et récits diffusés, les canaux de diffusion utilisés, et les effets potentiels sur le discours public et la stabilité sociale.

Les cas présentés dans ce rapport montrent des tentatives coordonnées de manipulation de l’information dans le but de décrédibiliser les institutions ivoiriennes et de compromettre le processus électoral.

Contexte général

En 2025, la Côte d’Ivoire se trouve à un carrefour politique complexe. Les élections présidentielles prévues en octobre s’annoncent incertaines. Alassane Ouattara, arrivé au pouvoir en 2011 après une crise post-électorale qui fait plus de 3 200 morts, est soupçonné de briguer un quatrième mandat, alors que ses principaux opposants, notamment l’ancien président Laurent Gbagbo, sont exclus du processus électoral.

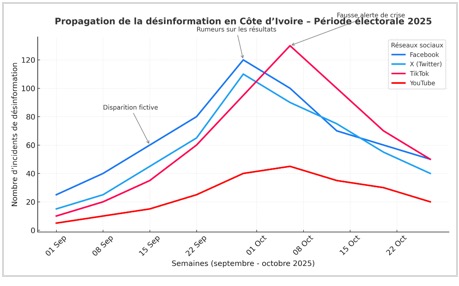

Dans le pays, le souvenir de la crise post-électorale de 2010-2011 reste un traumatisme national et chaque nouvelle échéance électorale ravive les craintes d’instabilité. Le paysage médiatique a été profondément transformé par la pénétration d’Internet (2,6% en 2010 et 38,4% en 2024) et l’adoption massive des réseaux sociaux.

Avec plus de 11,23 millions d’internautes présents sur Facebook, X, TikTok, Instagram, WhatsApp, etc. ; l’espace numérique est devenu la principale arène du débat public. Peu régulé, cet espace est fertile à la désinformation de tout genre. Plusieurs ivoiriens gardent encore les souvenirs de crises passées provoquées par les rumeurs et les fausses informations.

Graphique montrant les flux de diffusions de fausses informations sur le processus électoral en Côte d’Ivoire / Source : RAJP 2025

Polarisation extrême du débat public autour des leaders politiques et leurs coalitions et méfiance envers les institutions perçues par une partie de la population comme partiales. C’est dans ce contexte que les acteurs politiques et leurs partisans manipulent l’information sur les espaces numériques pour mobiliser leurs bases et discréditer leurs adversaires.

Acteurs

Les acteurs identifiés dans les cas de désinformation sont principalement des comptes de réseaux sociaux et des individus qui servent de points de diffusion ou d’amplification des récits. Ils opèrent sous des pseudonymes ou des noms de page qui suggèrent une affiliation ou une posture d’information.

| Catégorie d’acteur | Noms/comptes identifiés | Plateformes principales | Rôle dans la désinformation |

| Diffuseurs primaires | Souley DeParis B-52, Légion AES, Fils du Faucon noir, Tingin-biiga, Dame Masso, Farafina Wamy, cte.divoire38 | Facebook, X (ex-Twitter), TikTok | Incitation et diffusion des fausses informations. Ces comptes sont souvent les premiers à publier les récits. |

| Amplificateurs | Communautés d’utilisateurs (via partages et commentaires) | Facebook, X (ex-Twitter) | Augmentation de la visibilité et de la portée des messages créant un effet de caisse de résonance |

L’analyse des contenus diffusés par les acteurs identifiés montre une tendance à utiliser des noms à forte connotation politique ou identitaire, par exemple « Légion AES », « Tingin-biiga » (enfant du terroir en langue locale mooré), ou des noms qui suggèrent une source d’information privilégiée (Fils du Faucon noir).

La récurrence des publications de certains acteurs comme Souley DeParis B-52 (impliqué dans des récits de violence et de sabotage institutionnel) et Légion AES (axé sur la délégitimation du processus électoral et l’anti-France) indique des sources de désinformation potentiellement organisées ou du moins très actives.

Buts poursuivis

Les objectifs stratégiques derrière ces campagnes de désinformation sont multiples et visent à miner la confiance publique dans les institutions et à exacerber les tensions sociales et politiques en amont des élections de 2025.

| Objectif stratégique | Description et exemples de cas |

| Délégitimer le processus électoral | Semer le doute sur la régularité et la crédibilité des élections à travers de fausses informations sur la fuite de résultats avant le scrutin, la disparition du président de la Commission Électorale Indépendante (CEI), la présence de l’ONU et de militaires français pour un « braquage électoral« . |

| Fragiliser l’ordre public et de la stabilité du pays | Viser la neutralité et l’efficacité des forces de l’ordre par des récits de soldats décédés lors d’une mission politique, de tentative de cacher cette information par la hiérarchie militaire et l’élite politique |

| Inciter à la violence et à la révolte | Pousser les populations ou les partisans de figures politiques à des actions violentes avec des fausses annonces de l’arrestation de l’ancien président et figure emblématique de l’opposition, Laurent Gbagbo, la publication et l’amplification de fausse information sur des affrontements sanglant à Azaguié. |

| Créer la psychose et la panique | Diffusion et amplification de rumeurs alarmantes pour générer un sentiment d’insécurité, par exemple le faux enlèvement du couple Sery. |

Campagnes et récits

- Attaques de la CEI

Les récits identifiés se concentrent principalement sur trois thèmes majeurs : la politique, la violence et l’ethnie. Ces récits sont conçus pour être polarisants et émotionnellement chargés. Ils visent directement le pouvoir en place, le processus électoral et les figures de l’opposition.

Les récits politiques s’articulent autour de deux grands axes : la remise en cause de la légitimité du juge électoral (Conseil constitutionnel), de la Commission Électorale Indépendante (CEI) et la dénonciation d’un pouvoir présenté comme autoritaire et illégitime.

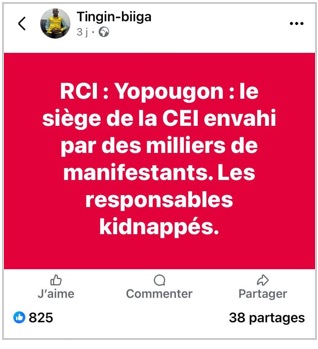

Les rumeurs qui affirment que « le siège de la CEI a été envahi par les populations en colère » constituent un exemple typique de manipulation de l’information pour susciter des mouvements de foule.

Capture d’une publication Facebook sur une fausse attaque du siège de la CEI à Yopougon à Abidjan

Selon un communiqué officiel de la CEI, seul le siège local de Yamoussoukro a été brièvement attaqué par des manifestants, provoquant l’incendie d’un bâtiment administratif, mais aucun blessé n’a été déploré et la sécurité a été aussitôt renforcée.

Mais sur les réseaux sociaux, l’incident est exagérément amplifié, généralisant à tout le siège national et attribuant une dimension massive (« populations en colère ») qui ne correspond pas à la réalité constatée.

Ce phénomène s’inscrit dans une stratégie de désinformation fréquente en période électorale : dramatisation de faits isolés, cadrage sensationnaliste et amplification sur les réseaux sociaux pour miner la confiance dans les institutions.

Impact et enseignements

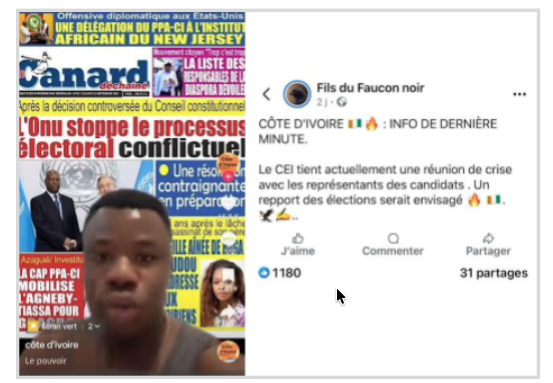

La publication affirmant que « le président de la CEI est porté disparu » a connu une forte audience sur Facebook, totalisant plusieurs milliers de vues et de partages en seulement quelques heures, principalement entre le 24 et le 26 octobre 2025.

Elle a généré des centaines de commentaires, certains relayant la rumeur tandis que d’autres questionnaient sa véracité ou appelaient à la prudence. L’effet principal de ce type de fake news est de nourrir l’incertitude et la tension au sein de l’opinion, déjà fragilisée par la polarisation politique et la concurrence des narratifs sur le scrutin.

La réaction proactive de la CEI et des médias de fact-checking a permis de désamorcer la rumeur avant qu’elle ne gagne une large crédibilité. Ce cas rappelle la nécessité d’une communication institutionnelle réactive et d’une vigilance citoyenne accrue face à la manipulation de l’information en période électorale.

Capture d’écran de publication fake sur la disparition du président du CEI

Typologie des commentaires et comportements observés

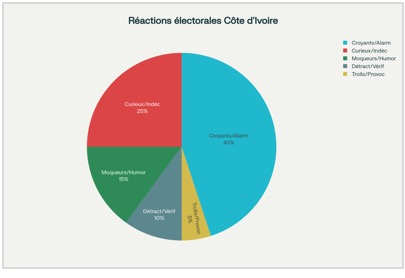

| Catégorie de réaction | Description du comportement | Exemples types (formulés ou observables) | Part estimée | Analyse stratégique |

| 🟥 Croyants / Alarmistes | Acceptent la fausse information comme vraie et la diffusent à leur tour. | “C’est grave !”, “Que Dieu sauve la Côte d’Ivoire”, “C’est fini pour Ouattara” | ≈ 45 % | Le cœur de la viralité. Ils déclenchent la propagation primaire et entretiennent la peur. |

| 🟨 Curieux / Indécis | Demandent des preuves ou des liens sans vérifier eux-mêmes. | “Source ?”, “C’est vrai ça ?”, “Quelqu’un peut confirmer ?” | ≈ 25 % | Représentent une opportunité pour corriger, mais restent vulnérables faute de sources fiables. |

| 🟦 Moqueurs / Détournement humoristique | Utilisent le sarcasme ou des émojis pour ridiculiser l’annonce. | “Encore un disparu imaginaire 😂”, “Même les présidents de CEI disparaissent maintenant ?” | ≈ 15 % | Détendent la tension, mais amplifient la visibilité algorithmique du post. |

| 🟩 Détracteurs / Vérificateurs | Dénoncent la rumeur, appellent au calme ou à la vérification. | “C’est faux, la CEI n’a rien publié”, “Arrêtez d’inventer des choses !” | ≈ 10 % | Minoritaires et souvent noyés dans le bruit émotionnel. Peu d’impact. |

| ⚫ Trolls / Provocateurs | Profitent du chaos pour attiser la division politique ou ethnique. | “C’est bien fait pour eux”, “On récolte ce qu’on sème” | ≈- 5 % | Peu nombreux, mais amplifient la polarisation et la violence verbale. |

Diagramme circulaire des catégories de commentaires et des comportements lors des élections d’octobre 2025 en CI

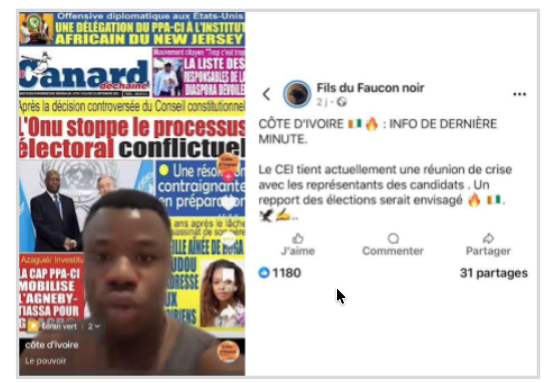

- « L’ONU a décidé de suspendre le processus électoral en Côte d’Ivoire »

La fake news selon laquelle « l’ONU a décidé de suspendre le processus électoral en Côte d’Ivoire » est largement diffusée sur les réseaux sociaux à l’approche du scrutin présidentiel d’octobre 2025. Cette fausse information, souvent relayée sur TikTok et Facebook, prétendait qu’une prise de position des Nations unies imposerait l’arrêt ou la suspension des élections ivoiriennes en raison de prétendues irrégularités ou tensions dans le pays.

L’analyse montre que cette fake news découle principalement de la manipulation de publications relatives à l’implication de l’ONU sur certaines questions électorales, notamment le suivi des recours de personnalités politiques dont la candidature avait été invalidée.

Ces contenus reprennent des faits réels (consultations ou communications onusiennes) en les détournant pour faire croire à une mesure radicale qui n’a jamais été prise en 2025. En réalité, l’ONU a toujours affirmé le respect du calendrier électoral et n’a ni suspendu ni remis en cause le processus en Côte d’Ivoire.

Capture d’écran des publications Facebook et TikTok sur une fausse décision de l’ONU sur le processus électoral en Côte d’Ivoire

● Récits de violence et de sabotage

Les récits de violence se fondent sur la manipulation d’images spectaculaires et de témoignages dramatiques pour provoquer une réaction de peur et d’indignation. Les principaux exemples sont la fausse information sur la mort de gendarmes suite à une « mission politique » ; la vidéo du péage d’Attingué en feu, attribuée à une manifestation anti-quatrième mandat et les rumeurs d’enlèvements de civils et d’attaques ciblées.

Capture d’écran de fausses publications sur des violences et des actes de sabotages à Abidjan

Ces contenus diffusés sur Facebook, TikTok et X ont été largement partagés avant d’être démentis. Les publications sont accompagnées de phrases-choc telles que « La patrie ou la mort, nous vaincrons ! » (un slogan révolutionnaire répandu au Burkina Faso), « Dignes Ivoiriens, sortons défendre notre pays ! ».

Ces récits incitent à la désobéissance civile, trouble à l’ordre public, la méfiance envers l’armée et la police, et peuvent déclencher des actes de violences réelles. Ils fonctionnent comme des détonateurs émotionnels, attisant la colère et la peur.

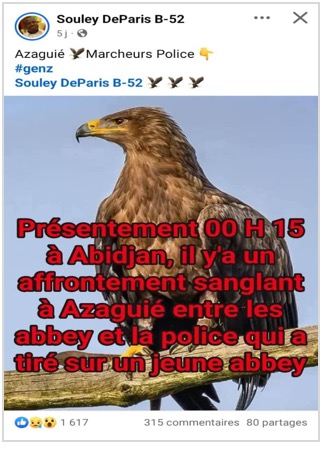

- Récits ethniques

Les récits ethniques exploitent la mémoire des tensions passées et les fractures identitaires encore sensibles dans la société ivoirienne. L’exemple le plus emblématique est celui d’Azaguié, où une publication affirmait que la police avait tiré sur un jeune Abbey. Ce type de message ne se contente pas de relater un fait : il désigne un ennemi collectif et ravive des blessures communautaires.

Capture d’écran d’une publication Facebook qui ravive les tensions ethniques pendant la période électorale

Ces narratifs ont pour effet de rappeler les conflits intercommunautaires passés (Abbey, Baoulé, Bété, etc.) ; créer un climat de suspicion entre groupes ethniques et transformer un incident isolé en symbole de persécution collective.

Le ton employé dans ces publications est souvent accusateur, jouant sur l’idée que certaines communautés seraient ciblées ou discriminées par le pouvoir en place. Ces récits ethniques ne cherchent pas seulement à désinformer, mais à diviser profondément la société en opposant des appartenances identitaires.

Note finale

Ces récits ont entraîné une érosion massive de la confiance dans les institutions, notamment le Conseil constitutionnel et la Commission Électorale Indépendante (CEI), le gouvernement et les forces de l’ordre. En diffusant de fausses informations sur de prétendues fraudes électorales ou des manipulations politiques, ils ont installé un sentiment d’insécurité institutionnelle.

Les récits liés à la violence et à l’ethnie ont amplifié les divisions existantes au sein de la société ivoirienne. En diffusant des messages accusant certaines communautés (comme les Abbey à Azaguié) ou en exagérant les tensions locales, ces narratifs ont ravivé les blessures identitaires et les souvenirs de conflits passés. Ils ont contribué à renforcer les clivages communautaires et à détériorer la coexistence pacifique entre groupes ethniques, favorisant la suspicion et la peur de « l’autre ».

Les récits politiques et violents, diffusés sur Facebook, TikTok et X, ont généré un climat de tension politique permanent. Ils ont fait croire à une situation d’instabilité imminente avec des récits d’attaques, d’enlèvements et d’émeutes alors que la majorité de ces événements étaient fictifs. Cette stratégie a cherché à provoquer des réactions émotionnelles pouvant conduire à des manifestations.

La répétition constante de ces récits alarmistes crée une fatigue émotionnelle collective. Selon plus experts en santé mentale, les citoyens exposés en continu à des messages anxiogènes développent un sentiment d’angoisse sociale et une perte de repères, où la vérité devient difficile à distinguer du mensonge.

Ce brouillage de l’information affaiblit la capacité de discernement et incite à réagir impulsivement en partageant, en commentant ou en s’indignant plutôt qu’au lieu de réfléchir. Les algorithmes des plateformes comme Facebook et TikTok, privilégiant les contenus les plus engageants, ont une part de responsabilité dans ce désordre de l’information.

Ce rapport a été produit par le Réseau Action Justice et Paix dans le cadre du programme d’incubation du Programme de bourses institutionnelles African Digital Democracy Observatory (ADDO). Il a été réalisé sous le parrainage de Code for Africa, avec le soutien technique de la Deutsche Gesellschaft für Internationale Zusammenarbeit (GIZ) GmbH, financée par le Bundesministerium für wirtschaftliche Zusammenarbeit und Entwicklung (BMZ) et l’Union européenne (UE). ADDO respecte l’indépendance journalistique des chercheurs, en leur offrant l’accès à des techniques et des outils avancés. La prise de décision éditoriale reste du ressort du Réseau Action Justice et Paix/Vincent NAKOYE. Vous souhaitez en savoir plus ? Visitez https://disinfo.africa/